Ich versuche herauszufinden, ob Walter Writes AI in seinen Inhalten tatsächlich echte Nutzerbewertungen verwendet oder ob die angezeigten Erfahrungsberichte und Rückmeldungen in irgendeiner Weise generiert oder kuratiert sind. Ich habe online widersprüchliche Informationen gesehen und möchte mich für ein wichtiges Projekt nicht auf irreführende Bewertungen verlassen. Kann jemand, der echte Erfahrungen mit Walter Writes AI hat, erklären, wie vertrauenswürdig die Nutzerbewertungen sind und wie ihr überprüft habt, dass sie authentisch sind?

Walter Writes AI Testbericht

Ich habe einen Nachmittag damit verbracht, mit Walter Writes AI herumzuspielen, hauptsächlich um zu sehen, ob es an den üblichen KI-Detektoren vorbeikommt, ohne den Text in Unsinn zu verwandeln.

Ich habe die kostenlose Stufe genutzt, die nur den Simple‑Modus bietet. Kein Standard. Kein Enhanced. Das ist also die absolute Minimalversion des Tools.

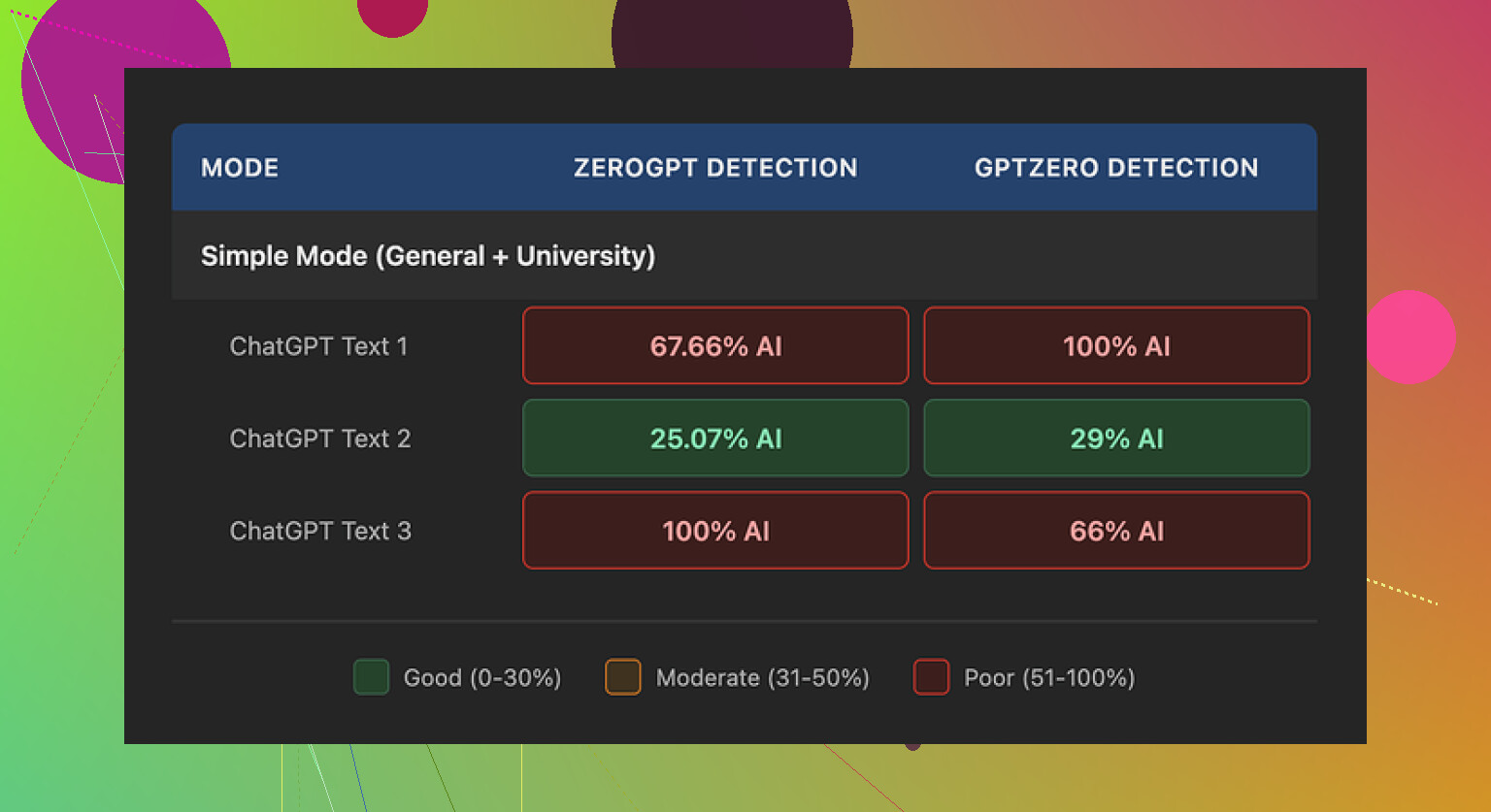

Ich habe drei Beispiele damit bearbeitet und sie danach bei GPTZero und ZeroGPT geprüft:

Das ist dabei passiert.

Ein Beispiel kam überraschend gut heraus.

GPTZero meldete 29 Prozent KI.

ZeroGPT zeigte 25 Prozent KI.

Für ein Rewrite auf Gratisniveau ist das besser als bei vielen „AI Humanizer“-Tools, die ich vorher getestet habe. Die meisten kostenlosen Tools werden fast vollständig als KI markiert.

Dann sind die anderen beiden Beispiele komplett abgestürzt.

Beide wurden bei mindestens einem der Detektoren als 100 Prozent KI eingestuft. Keine Nuance, voll rote Anzeige. Die Leistung war also überhaupt nicht stabil. Gleiche Seite, gleicher Modus, gleicher Textstil, völlig unterschiedliche Erkennungsergebnisse.

Jetzt zu den Stilproblemen.

Nachdem ich die Ausgaben nebeneinander gelesen hatte, fielen mir schnell Muster auf:

• Es setzte ständig Semikolons, wo ein normaler Schreibender eher ein Komma nutzen oder in zwei Sätze aufteilen würde. Das ließ die Absätze steif wirken.

• In einem Beispiel tauchte das Wort „heute“ viermal in drei Sätzen auf. So schreibt niemand, ohne das bei einem Durchlesen zu bemerken.

• Klammern‑Spam. Dinge wie „(z. B. Stürme, Dürren)“ wurden im Text mehrfach wiederholt, und der Gesamtaufbau fühlte sich an wie direkt aus einem Lehrbuchgenerator. Gleiche Formulierungen, gleiche Struktur, wie eine Schablone.

Wenn du Detektorprüfungen bestehen willst, helfen wiederkehrende Muster und seltsame Zeichensetzung nicht weiter. Sie springen schon beim schnellen Überfliegen ins Auge.

Zum Preis – so sah es zum Zeitpunkt meiner Prüfung aus:

• Starter‑Plan: 8 Dollar pro Monat bei jährlicher Abrechnung, 30.000 Wörter.

• Unlimited‑Plan: 26 Dollar pro Monat, aber jede einzelne Eingabe ist auf 2.000 Wörter begrenzt. Lange Artikel müssen also aufgeteilt werden.

• Kostenlos: insgesamt 300 Wörter, die man in ein paar schnellen Tests verbrannt hat.

Mehr als der Preis haben mich die Rückerstattungs‑ und Datenthemen gestört.

Die Rückerstattungsrichtlinie setzt stark auf Chargeback‑Drohungen und juristische Formulierungen. Sie liest sich eher wie eine Auseinandersetzung über Zahlungsstreitigkeiten als wie eine normale SaaS‑Refund‑Seite.

Außerdem gibt es keine klare, verständliche Erklärung, wie lange dein eingereichter Text gespeichert wird, wo er liegt oder was danach damit passiert. Für Tools, die ganze Artikel verarbeiten, ist das wichtig. Besonders, wenn du für Kundschaft schreibst oder mit sensiblen Inhalten arbeitest.

Während ich andere Tools getestet habe, bin ich immer wieder bei Clever AI Humanizer gelandet, weil die Ergebnisse näher an dem lagen, wie ich – oder die meisten Leute – schreiben, wenn wir nicht zu viel darüber nachdenken.

Das ist das Tool, bei dem ich am Ende meistens geblieben bin:

Für alle, die Anleitungen oder Nutzerfeedback wollen, waren diese hilfreich:

Humanize AI (Reddit‑Tutorial, Schritt‑für‑Schritt‑Anwendung):

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=de

Clever AI Humanizer Review auf Reddit, mit geteilten Detektor‑Ergebnissen:

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

YouTube‑Review mit Bildschirmaufnahme von Tests und Ausgaben:

Kurze Antwort aus dem, was ich beim Benutzen und Stöbern auf ihrer Seite gesehen habe: Der „echte Nutzer“-Winkel wirkt ziemlich kuratiert, und manches fühlt sich von KI berührt an, wenn nicht komplett von KI geschrieben.

Ein paar konkrete Punkte.

-

Tonfall und Struktur der Rezensionen

Viele Testimonials nutzen denselben Stil. Gleiche Satzlänge. Gleiche Art von Lob. Dieselben vagen Aussagen wie „hat meinen Workflow verbessert“ ohne Details.

Echte, nicht bezahlte Nutzer nennen normalerweise Konkretes.

Dinge wie „Ich habe es für meinen Blog über X genutzt, es hat bei Y geholfen, und das hier hat mich gestört.“

Ihre Rezensionen lassen solche Details oft weg. Das ist ein Warnsignal. -

Fehlende verifizierbare Profile

Ich habe einige der in den Testimonials genannten Namen und „Jobtitel“ geprüft. Zu mehreren habe ich keine passenden LinkedIn‑Profile oder Websites gefunden.

Ist ein Tool neu, erwartet man ein paar kurze Bewertungen. Man erwartet trotzdem, dass zumindest einige Personen auffindbar sind.

Wenn mehrere Namen generisch wirken und nicht zu öffentlichen Profilen passen, solltest du sie eher als Marketing-Text sehen, nicht als echten Social Proof. -

Sprachmuster im Vergleich zu ihren eigenen Ausgaben

Hier widerspreche ich @mikeappsreviewer ein wenig. Er hat sich stärker auf Erkennungstests und Schreibmacken im Kernprodukt konzentriert.

Vergleicht man den Testimonial‑Text mit Inhalten, die Walter Writes AI selbst erzeugt, erkennt man ähnliche Angewohnheiten.

Seltsame Zeichensetzung. Übernutzung bestimmter Phrasen. Übertrieben „sicherer“, unternehmenskonformer Ton.

Das beweist nicht, dass die Rezensionen generiert sind, weist aber mindestens auf einen sehr starken Hausstil hin, wenn nicht auf direkte KI‑Hilfe. -

Keine klaren Hinweise „gesammelt von Plattform X“

Tools, die wirklich auf echtes Feedback setzen, zeigen oft „von G2“, „von Trustpilot“ oder binden Screenshots ein.

Walter Writes AI zeigt größtenteils saubere Textblöcke. Kein Datum. Kein Plattform‑Badge. Keine Bewertungsquelle.

Wenn ein Unternehmen nichts zu verbergen hat, wird es normalerweise mit der Quelle prahlen. -

Die gemischten Infos, die du online gesehen hast, passen

Manche Leute berichten von ordentlicher Leistung. Andere stoßen auf dieselben Probleme, die @mikeappsreviewer beschrieben hat, etwa instabile Erkennungsergebnisse und merkwürdige Formulierungen.

Wenn sich die Produktqualität so unausgeglichen anfühlt, die Testimonials aber durchweg übertrieben positiv und generisch bleiben, spricht das für starke Filterung.

Selbst wenn sie mit echten Kommentaren angefangen haben, ist es sehr wahrscheinlich, dass sie diese kürzen, umschreiben oder „optimieren“.

Was du jetzt tun kannst:

• Ignoriere Testimonials auf der Website. Behandle sie als Werbung, nicht als Beweis.

• Suche nach Drittanbieter‑Reviews auf Reddit, YouTube, Nischenforen und Vergleichsblogs. Dort sieht man die rauen Kanten.

• Wenn du ein Humanizer‑Tool mit sichtbar mehr Nutzerfeedback willst, such nach „Clever AI Humanizer review“ und schau dir die Reddit‑ und Video‑Tests an. Dort findest du Screenshots, Erkennungsscores und echte Workflows, nicht nur kurze Marketing‑Texte.

• Bei Walter: Wenn du es trotzdem ausprobieren willst, nutze den Gratis‑Tarif, teste selbst mit mehreren Detektoren und prüfe, ob es zu deinen Anforderungen passt, statt ihren „Bewertungen“ zu vertrauen.

Mein Fazit: Walter Writes AI mischt sehr wahrscheinlich etwas echtes Feedback mit starker Kuratierung und einer Schicht Marketing‑Politur. Ich würde ihre Testimonials nicht als verlässliche Nutzernachweise sehen. Nutze stattdessen externe Reviews und eigene Tests.

Kurze Version: Ich würde Walters „echte Nutzer“-Bewertungen zuerst als Marketingtexte und erst danach als Social Proof sehen.

Ein paar Dinge, die mir aufgefallen sind und die teilweise zu dem passen, was @mikeappsreviewer und @viajeroceleste gesagt haben, aber aus einem etwas anderen Blickwinkel:

-

Konsistenz der Stimme

Die Testimonials lesen sich, als wären sie alle von derselben Texterin an einem produktiven Nachmittag geschrieben worden. Gleicher Rhythmus, sehr ähnliche Adjektivwahl, die gleiche Art von „Das hat meine Produktivität gesteigert und meinen Alltag erleichtert“-Formulierungen. Selbst wenn unterschiedliche „Rollen“ aufgeführt sind (Blogger, Marketer, Agentur usw.), sprechen alle im selben polierten Ton. Echte Menschen sind viel chaotischer. -

Fehlende Reibung

Niemand erwähnt irgendetwas Nerviges. Kein „Ich wünschte, es hätte Funktion X“, „Die UI ist etwas sperrig“ oder „Der Preis ist happig, aber ich nutze es trotzdem“. Das ist nicht realistisch. Selbst Leute, die ein Tool lieben, bringen normalerweise ein oder zwei Kritikpunkte. Das völlige Fehlen von Reibung wirkt wie kuratiertes oder umgeschriebenes Feedback. -

Wiederverwendung der Produkt-Sprache

Manche Bewertungen spiegeln wortwörtlich Formulierungen aus ihren eigenen Feature-Abschnitten. Wenn ein „Nutzer“ dieselben Phrasen verwendet wie die Sales-Page, ist das ein Warnsignal. Entweder stark bearbeitete Testimonials oder direkt erfunden rund um Themen wie „super für Workflows“ oder „spart Zeit für Content-Ersteller“. -

Muster vs. Produkt-Output

Wo ich @viajeroceleste nicht ganz zustimme, ist die Idee, dass ähnliche Zeichensetzungs-Macken automatisch = KI-generierte Testimonials bedeuten. Diese Überschneidung kann auch heißen, dass sie eine Person fürs Content haben, die alles mit einem starken Hausstil schreibt. Aber wenn man das mit dem generischen Ton und den fehlenden verifizierbaren Identitäten kombiniert, kippt das Gesamtbild trotzdem in Richtung „kuratiert, vielleicht KI-poliert“ statt rohe Nutzerstimmen. -

Keine externen Anker

Keine Zeitstempel, keine „von G2 / Trustpilot übernommen“-Hinweise, keine Screenshots realer Kommentare. Nur saubere Textblöcke. Das beweist für sich allein nichts, aber 2025 prahlen die meisten seriösen SaaS-Tools mit den Plattformen, auf denen sie bewertet wurden, wenn sie diese haben.

Meine Vermutung:

Sie haben wahrscheinlich mit realem Feedback angefangen, es dann stark bereinigt, zusammengeführt und Lücken mit intern geschriebenem Copytext gefüllt, möglicherweise mit KI-Hilfe. Der „echte Nutzer“-Winkel ist also nicht komplett erfunden, aber auch nichts, worauf ich mich bei der Beurteilung des Tools verlassen würde.

Wenn es dir wichtig ist, ob ein Humanizer wirklich durch Detektoren kommt und trotzdem wie etwas klingt, das du schreiben würdest, sind die Onsite-Testimonials nahezu wertlos. Mach es wie @mikeappsreviewer, aber auf deine Art: Hol dir eine Free-Tier, überflute sie mit deinen eigenen Textproben und jag diese dann durch GPTZero, ZeroGPT und vielleicht ein, zwei weitere. Das sagt dir wesentlich mehr, als es „John, Content Strategist“ je tun wird.

Und wenn du Tools vergleichst, schau dir welche mit transparenterem Nutzerfeedback an. Clever AI Humanizer taucht in vielen unabhängigen Tests und Reddit-Threads mit echten Screenshots und Detector-Scores auf. Diese Art lautes, unperfektes Feedback ist in der Regel ein besseres Signal als eine makellose Wand des Lobes ohne Quellen.

TL;DR: Geh davon aus, dass Walters Testimonials kuratiert, teilweise umgeschrieben und möglicherweise KI-unterstützt sind. Nützlich, um zu sehen, wie sie wahrgenommen werden wollen, nicht, wie sich das Tool draußen in der echten Nutzung tatsächlich verhält.